À l’heure où les algorithmes transforment toutes les facettes du business digital, les réseaux de neurones s’imposent comme le nerf de la guerre en intelligence artificielle. Plus que de la théorie : aujourd’hui, leur impact est concret, mesurable, décisif dans la création de valeur pour les entrepreneurs et tech builders. Vision par ordinateur, analyse prédictive, automation de tâches répétitives… Les réseaux neuronaux deviennent accessibles même sans doctorat en mathématiques. Le vrai enjeu ? Comprendre, expérimenter, appliquer. C’est ce que découvrira ici tout créateur digital qui cherche à passer de la curiosité à l’action : la puissance des réseaux de neurones pour booster son projet IA, en 2026, sans tomber dans le piège de la complexité stérile ou des promesses miracles. Les stratégies, les outils et les limites : tout ce qu’il faut pour passer de la découverte à l’automatisation rentable.

- Les réseaux neuronaux imitent le cerveau humain pour reconnaître des motifs, automatiser et prédire.

- Ils sont au cœur des technologies innovantes : de la reconnaissance d’image à la finance, ils boostent la productivité.

- Leur force : apprendre à partir de grandes quantités de données et s’améliorer sans cesse.

- En 2026, l’IA générative et les réseaux spécialisés ouvrent de nouveaux horizons pour les entrepreneurs.

- Mais ils posent aussi de vrais défis : besoins massifs en data, coût de l’entraînement, manque d’explicabilité.

- Dans cet article, des exemples concrets, une analyse lucide et des méthodes actionnables pour intégrer ces systèmes à un business digital.

Comprendre les réseaux de neurones : fondements et logique appliquée

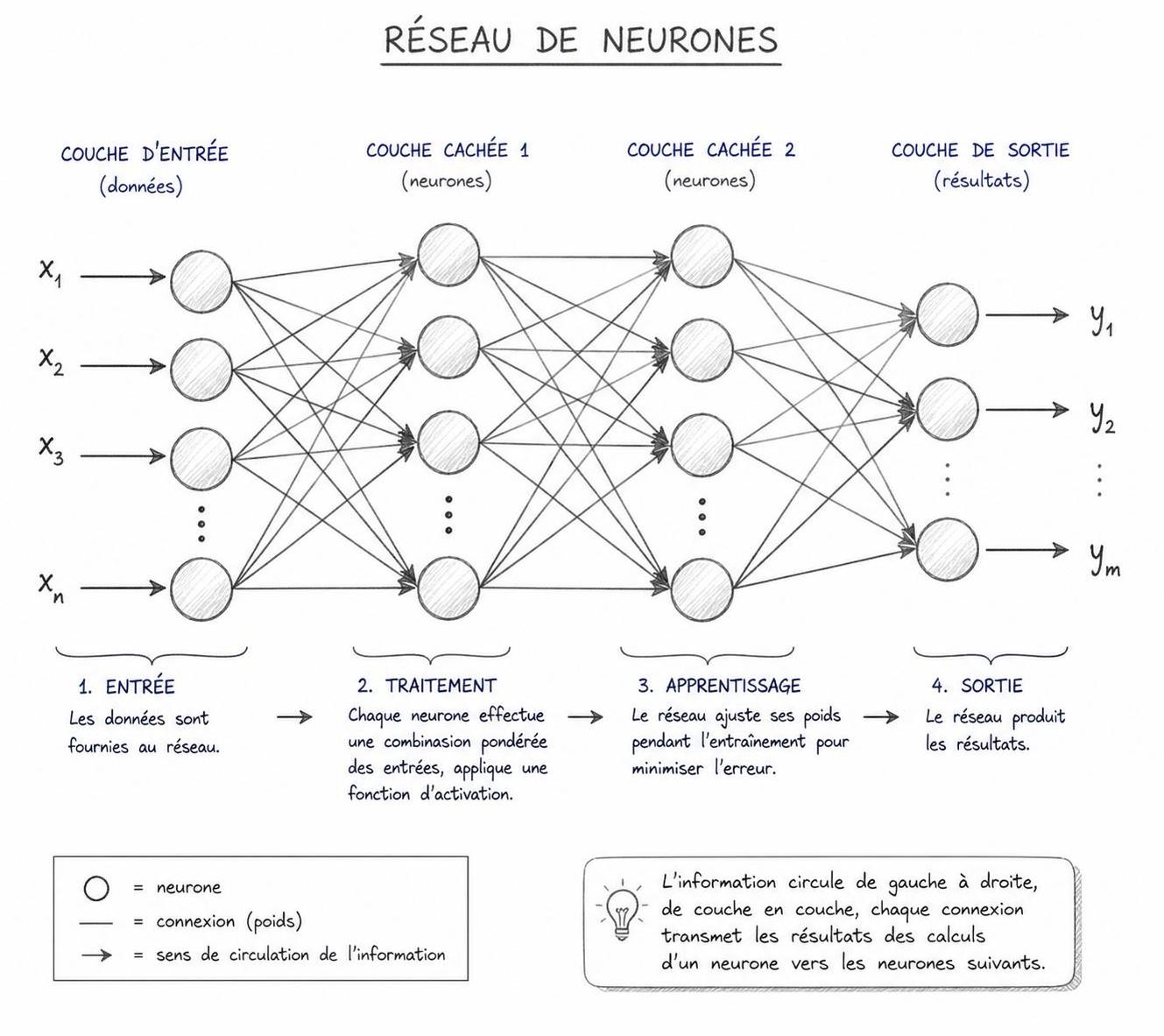

Oubliez les mythes hollywoodiens ou les explications incompréhensibles. Un réseau de neurones, c’est d’abord un modèle d’apprentissage construit pour résoudre des problèmes concrets. Imaginez un système composé de milliers, voire de millions de petites unités de calcul – les « neurones » artificiels – qui travaillent ensemble pour traiter l’information à la manière d’un cerveau simplifié. Ces unités se répartissent en plusieurs couches clés : la première reçoit les données brutes (l’image, le texte, ou même le bruit d’un capteur), la seconde les transforme et les analyse pour extraire des caractéristiques de plus en plus fines, et la dernière prend des décisions (classer, prédire ou générer une réponse).

Pas de magie ni de black box total ici. Derrière ce processus, tout repose sur l’ajustement progressif des connexions internes, appelées poids, grâce à un mécanisme d’apprentissage inspiré de la rétropropagation de l’erreur. Le réseau compare son output à la réalité, mesure son erreur, puis ajuste ses paramètres pour s’améliorer. À force de répétitions sur des milliers d’exemples, la machine affine sa capacité à détecter des motifs complexes là où l’œil humain ne voit que des pixels ou des chiffres.

Ce qui frappe, c’est la polyvalence de ces modèles. En traitement d’image, chaque pixel véhicule de l’information ; en analyse de texte, chaque mot trouve son importance. Pas étonnant que les plus grands outils d’IA générative s’appuient sur ces principes, comme détaillé sur l’article dédié à l’IA générative en 2026. L’essentiel, c’est de comprendre que la force réelle d’un réseau neuronal vient du volume des données, de la diversité et de la qualité des itérations durant l’entraînement. Plus il apprend, plus il devient performant, exact, utile pour de vraies tâches business.

On distinguera trois familles majeures dans l’architecture : les réseaux de base (Feedforward Neural Networks), les couches dites cachées qui permettent à la machine d’extraire des niveaux d’abstraction supérieurs (le fameux deep learning), et les réseaux récurrents ou convolutifs qui gèrent respectivement les séquences (texte, son) et la spatialisation des données (images, vidéos). En 2026, même une PME ou un freelance motivé peut expérimenter ces briques technologiques grâce aux frameworks comme PyTorch ou TensorFlow, sans être développeur à la base.

La clé pour qui veut automatiser, scaler ou prédire efficacement avec ces outils : partir d’une problématique métier claire, s’équiper d’un jeu de données pertinent, et comprendre la logique d’apprentissage par ajustement des poids. Cette logique « test, mesure, améliore » épouse parfaitement l’esprit du web business concret : on itère, on mesure, on adapte – et on finit par décrocher des résultats tangibles, pas des promesses vides.

Fonctionnement détaillé : du signal brut à la décision automatisée

Dans l’univers du digital, ce qui distingue vraiment le réseau de neurones des approches traditionnelles, c’est sa capacité à transformer de la donnée brute en décision ou en prédiction, via un enchainement précis d’opérations. Imaginons Alice, entrepreneure qui veut automatiser la qualification de leads sur son site e-commerce : chaque visiteur laisse une trace (clics, pages vues, panier, géolocalisation…). Passer ces données par un réseau de neurones permet de prédire, en temps réel, s’il s’agit d’un prospect chaud ou d’un simple curieux. Au centre de tout processus, on retrouve trois mécanismes essentiels : la pondération des signaux (les fameux poids), l’ajout d’un biais pour ajuster la sensibilité du neurone, et l’application d’une fonction d’activation non linéaire. Cette dernière – qu’il s’agisse de la ReLU, de la Sigmoïde, ou du Softmax – joue le rôle de filtre intelligent pour gérer des données non linéaires, autrement dit, tout ce qui ne rentre pas dans des cases simples.

L’apprentissage se déroule étape par étape. La machine effectue une prédiction, compare le résultat à la réalité (est-ce vraiment un lead chaud ?), puis ajuste tous ses poids en conséquence, grâce à la propagation de l’erreur. C’est ce fameux backpropagation. Ce processus est répété des milliers de fois sur différents exemples. Résultat : plus le réseau évolue, plus il capture des subtilités (heure de navigation, habitudes, comportements rares).

Mais réussir ce « dressage » technologique n’est pas sans difficulté. L’entraînement demande de la puissance (GPU, cloud), une base de données énorme, et du temps. Les erreurs d’overfitting – où la machine apprend par cœur sans généraliser – sont fréquentes, notamment dans le cas de datasets trop petits ou trop homogènes. Comme toujours dans le digital : automatiser sans comprendre pourquoi un algorithme donne un résultat, c’est juste accélérer ses propres erreurs.

Petit aperçu des éléments concrets qui composent un réseau :

- La couche d’entrée : reçoit la donnée et la structure selon ses paramètres essentiels.

- Les couches intermédiaires/cachées : extraient les caractéristiques pertinentes, à l’aide de fonctions d’activation variées.

- La couche de sortie : livre la décision finale, binaire (oui/non) ou multi-classes (plusieurs profils d’utilisateurs, etc.).

Cette mécanique rigoureuse, largement industrialisée dans le SaaS ou l’e-commerce, sert aussi bien la détection de faux paiements que l’optimisation de la recommandation. Et dans chaque cas, ce n’est pas la théorie qui compte, mais la capacité à brancher ses propres données, à tester, à mesurer des résultats sur la conversion ou la satisfaction utilisateur.

Réseaux neuronaux : applications business concrètes en 2026

Impossible de parler intelligence artificielle sans illustrer, outils à l’appui, le potentiel opérationnel des réseaux de neurones. Sur le terrain, leurs applications explosent dans des secteurs qui, il y a cinq ans, étaient encore sceptiques. La reconnaissance d’images a bouleversé la gestion de catalogue produit, la maintenance industrielle et même l’analyse du trafic urbain grâce aux caméras connectées. Chaque photo, chaque vidéo est passée au crible par des architectures dites CNN (Convolutionnal Neural Networks), championnes pour découper, classifier, taguer du visuel en masse. Dans le business B2B, des réseaux spécialisés détectent les anomalies sur des images de production 24/7, économisant des centaines de milliers d’euros en maintenance prédictive.

Point fort aussi dans le traitement du langage naturel (NLP) : tout ce qui touche à la génération de texte automatique, traduction, chatbot ou analyse de sentiment relève désormais du réseau neuronal. Les transformateurs, et en particulier les modèles GPT-like, révolutionnent le marketing automation, la veille, la création de contenu et support client. Pas besoin d’être ingénieur pour brancher ces outils à un flux de données, ou orchestrer son contenu via des API no-code. Pour ceux qui souhaitent approfondir ce pan, l’article sur l’intelligence artificielle appliquée aux entreprises déploie davantage de cas réels pour booster la productivité et l’automatisation.

Dans le secteur financier, l’analyse de séries temporelles, la lutte contre la fraude, la recommandation de produits et l’optimisation de portefeuille s’appuient sur des réseaux à mémoire longue (LSTM) ou hybrides, capables de détecter des signaux faibles noyés dans la masse. Même dans la logistique – prévision des stocks, planification des tournées – les réseaux neuronaux font le tri entre des dizaines de variables fluctuant en continu, là où un humain saturerait.

Petit zoom chiffré, à travers le prisme d’une TPE qui automatise l’analyse de ses données clients :

| Domaines d’application | Bénéfices concrets obtenus | Type de réseau utilisé |

|---|---|---|

| Reconnaissance d’image (catalogue produit) | Identification automatique, réduction des erreurs humaines, gain de temps de +70% | CNN |

| Analyse de texte (support client) | Filtrage automatique des demandes, meilleure priorisation, satisfaction client accrue | Transformers |

| Détection de fraude financière | Réduction de la fraude, détection précoce des anomalies, ajustement en temps réel | Réseaux hybrides |

| Optimisation du stock logistique | Prévision fine des besoins, réduction du gaspillage, flux optimisé | Réseaux récurrents (LSTM) |

La force du moment, c’est l’accessibilité : un freelance, un responsable CRM, même un artisan connecté peuvent s’équiper d’outils IA opérant en tâche de fond, sans réinventer la roue. L’enjeu : identifier LA tâche à impact business maximal à automatiser par un réseau de neurones – et mesurer la valeur créée. Ce n’est plus une tendance, c’est un mouvement de fond en 2026.

Bénéfices clés et pièges à éviter pour les créateurs du web

Sur le papier, intégrer un réseau de neurones à son business digital, c’est l’assurance d’une automation intelligente : analyse des comportements utilisateurs, personnalisation en temps réel, génération de contenus adaptés… Les promesses sont réelles, mais il faut décortiquer ce qui crée la valeur et ce qui peut piéger tout porteur de projet. Le premier vrai bénéfice, c’est la capacité d’apprentissage : chaque nouvelle donnée passée par le modèle rend le système plus précis, plus pertinent. À l’échelle d’un site web à fort trafic, la progression est même exponentielle.

Cela donne un avantage décisif en SEO, en conversion, en qualité de recommandation produit ou de support automatisé. Les meilleurs process observés : ne pas se contenter d’un réseau unique, mais mixer plusieurs briques : un modèle pour la détection d’intention, un autre pour la génération, un troisième pour la priorisation. C’est cette modularité qui fait la différence entre une IA gadget et un vrai moteur de croissance digitale.

Mais ne sous-estimez pas les limites. L’entraînement exige de la puissance de calcul (coûté ou passé en cloud), une data de qualité (le pétrole du XXIe siècle, mais sous-estimée en entreprise), et une vraie vigilance sur le surapprentissage. Trop entraîner un modèle sur un jeu de données trop réduit ou biaisé, c’est s’exposer à des décisions absurdes ou dangereuses. Dans certains secteurs – finance, santé – l’exigence d’explicabilité prend le dessus. On n’accepte plus de « boîtes noires » : il faut pouvoir auditer et expliquer chaque décision prise par l’algorithme.

Pour résumer, le terrain du digital récompense ceux qui :

- Donnent la priorité à la qualité des données plutôt qu’au volume pur.

- Sécurisent l’entraînement (cloud, GPU mutualisé, frameworks robustes).

- Automatisent en mesurant : chaque process IA doit être suivi (A/B testing, KPI précis).

- S’informent sur les nouveaux outils pour éviter la dette technique (Voir comment l’IA générative impacte la création web).

La dernière tentation ? Penser « IA » avant « stratégie ». Techniquement, rien ne remplace une vision claire du problème à résoudre. Un outil automatisé mal branché, c’est juste une erreur à grande vitesse. Commencez pragmatique, lancez petit, amplifiez les process qui donnent du ROI. C’est là que les réseaux neuronaux jouent leur vrai rôle d’amplificateur business.

Vers l’avenir : réseaux neuronaux évolutifs et scénarios business à anticiper

Regardons à deux ans, pas dix : l’évolution actuelle va transformer la façon dont chaque créateur, PME ou indépendant devra penser ses process d’automatisation et d’analyse. Les laboratoires d’IA locaux et les acteurs du cloud multiplient les offres de réseaux neuronaux spécialisés, taillés sur-mesure pour une tâche précise (analyse d’image médicale, scoring en crédit, génération de vidéos publicitaires, etc.). Ces micro-modèles consomment moins de data, s’entraînent plus vite, s’intègrent directement dans les workflows existants via API ou SaaS.

En 2026, les outils prennent aussi le virage de l’explicabilité. Expliquer pourquoi une IA prend telle ou telle décision devient un must, surtout dans la banque, la santé, le juridique. Les solutions hybrides mêlant réseaux neuronaux et méthodes symboliques remontent, permettant une meilleure traçabilité. On assiste aussi à la démocratisation des frameworks low-code et no-code pour orchestrer ses propres modèles sans expertise technique poussée.

L’automation s’accélère mais devient moins opaque. Les meilleurs créateurs anticipent déjà l’émergence de « réseaux vivants » : modèles capables de s’auto-adapter en fonction des changements du marché, des évolutions de l’offre web, ou de nouvelles contraintes réglementaires (RGPD, IA Act…). Cette capacité d’adaptation, c’est LA clé de demain pour rester compétitif – et éviter le syndrome du site ou de l’appli qui se ringardise plus vite qu’elle ne croît.

Pour aller plus loin, prenez l’exemple d’une agence web qui multipliait les landing pages avant chaque nouvelle campagne. Grâce à un réseau de neurones auto-adaptatif, elle automatise non seulement la création mais aussi l’optimisation continue : A/B tests programmés, détection d’anomalies, priorisation des efforts SEO. Alors pourquoi attendre ? La fenêtre est ouverte pour celles et ceux qui veulent transformer le buzzword IA en vrai booster de business digital, en combinant pragmatisme, croissance et maîtrise du risque technique.

Quels sont les principaux types de réseaux de neurones utilisés en intelligence artificielle ?

Les architectures majeures incluent les réseaux convolutifs (CNN) pour le traitement d’images, les réseaux récurrents (RNN, LSTM) pour la gestion de séquences de données (texte, séries temporelles), et les transformateurs pour le traitement du langage naturel et la génération de texte. Chacun répond à des besoins spécifiques en automatisation et précision.

Faut-il beaucoup de données pour exploiter un réseau neuronal ?

Un réseau neuronal standard nécessite effectivement un gros volume de données pour être performant. Cependant, l’arrivée de modèles pré-entraînés et de techniques comme le fine-tuning permettent d’obtenir de bons résultats même pour des PME disposant de datasets plus modestes, à condition que la qualité et la diversité soient au rendez-vous.

Comment éviter que le réseau n’apprenne uniquement ses exemples d’entraînement ?

Le surapprentissage (overfitting) peut être contré en séparant un jeu de validation, en utilisant des méthodes de régularisation, et en testant en continu sur de nouvelles données. L’A/B testing intelligent reste la meilleure solution pour garantir la généralisation du modèle.

Peut-on intégrer des réseaux neuronaux dans des outils no-code ou low-code ?

Oui, l’écosystème no-code/low-code a énormément évolué ces dernières années : plusieurs plateformes permettent d’accéder à des modules IA pré-entraînés ou de connecter ses propres modèles via API, même sans être développeur expert. Cela accélère la productivité des créateurs tout en démocratisant l’accès à l’IA.

Les réseaux de neurones remplaceront-ils les experts métiers ?

Non. Les réseaux neuronaux sont d’excellents assistants pour l’analyse, la recommandation ou l’automatisation, mais la compréhension métier, la prise de décision stratégique et l’éthique nécessiteront toujours une intervention humaine forte.